Benj Edwards / Ars Technica

El miércoles, el empleado de Microsoft Mike Davidson Anunciado que la empresa ha lanzado tres estilos de personalidad distintos para su bot Bing Chat experimental impulsado por IA: creativo, equilibrado o preciso. Microsoft ha sido pruebas la característica desde el 24 de febrero con un conjunto limitado de usuarios. Cambiar entre modos produce diferentes resultados que cambian su balance entre la precisión y la creatividad.

Bing Chat es un asistente impulsado por IA basado en un modelo avanzado de lenguaje grande (LLM) desarrollado por OpenAI. Una característica clave de Bing Chat es que puede buscar en la web e incrustar los resultados en sus respuestas.

Microsoft anunció Bing Chat el 7 de febrero, y poco después de su lanzamiento, los ataques de los adversarios llevaron regularmente a una versión anterior de Bing Chat a una locura simulada, y los usuarios descubrieron que se podía convencer al bot para que amenazar ellos. No mucho después, Microsoft ralentizó drásticamente las explosiones de Bing Chat al imponer límites estrictos en la duración de las conversaciones.

Desde entonces, la compañía ha estado experimentando con formas de recuperar algo de la personalidad atrevida de Bing Chat para aquellos que lo desean, pero también permite que otros usuarios busquen respuestas más precisas. Esto resultó en la nueva interfaz de “estilo de conversación” de tres opciones.

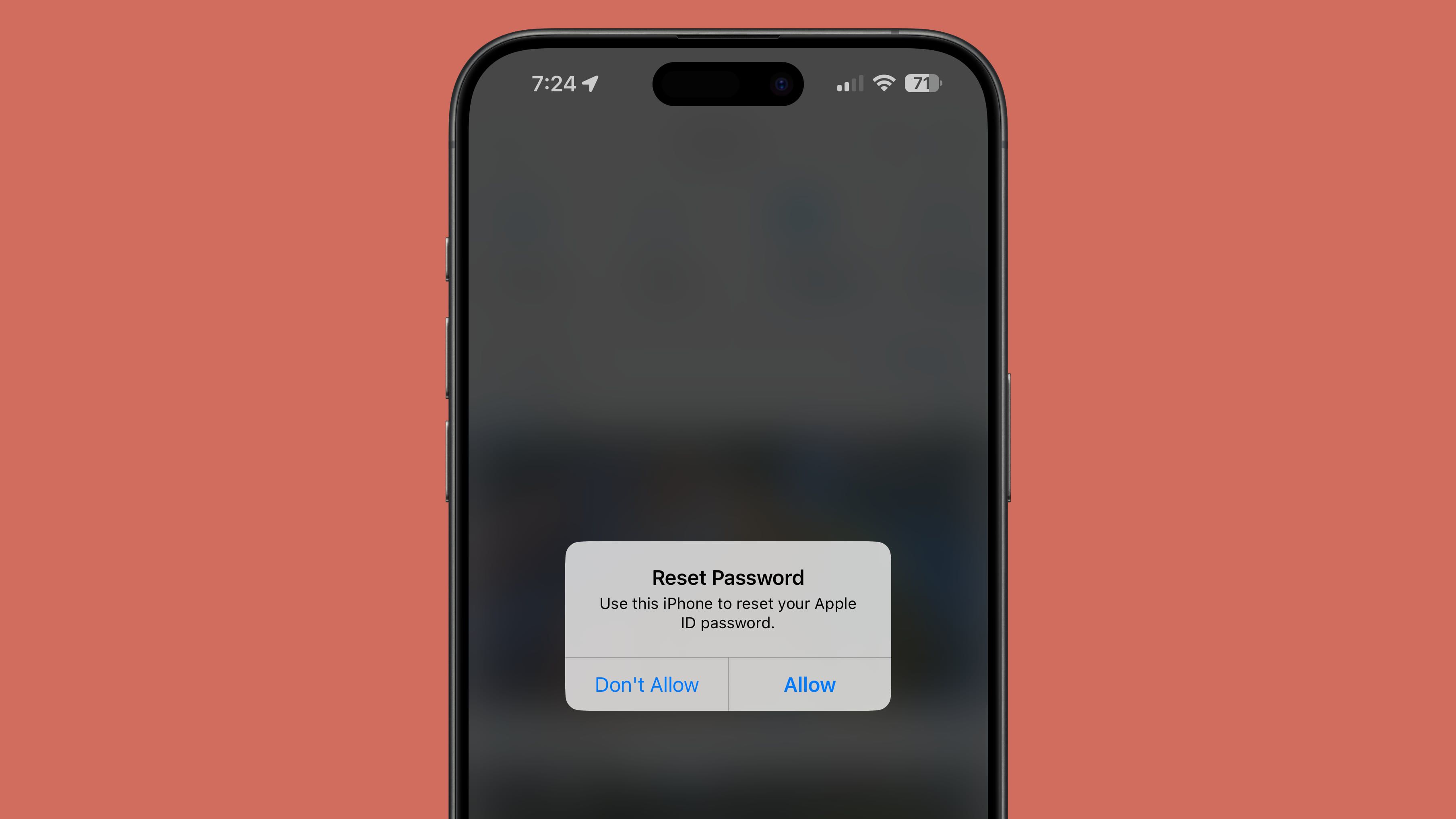

-

Un ejemplo del estilo de conversación “Creativo” de Bing Chat.

microsoft

-

Un ejemplo del estilo de conversación “Preciso” de Bing Chat.

microsoft

-

Un ejemplo del estilo de conversación “Equilibrado” de Bing Chat.

microsoft

En nuestros experimentos con los tres estilos, notamos que el modo “Creativo” producía pistas más cortas y excéntricas que no siempre eran seguras o prácticas. El modo “preciso” erró por el lado de la precaución, a veces no sugería nada si no veía una forma segura de obtener un resultado. En el medio, el modo “Equilibrado” a menudo producía las respuestas más largas con los resultados de búsqueda más detallados y las citas de sitios web en sus respuestas.

Con modelos de lenguaje grandes, las inexactitudes inesperadas (alucinaciones) a menudo aumentan en frecuencia con una mayor “creatividad”, lo que generalmente significa que el modelo de IA se desviará más de la información que ha aprendido de su conjunto de datos. Los investigadores de IA a menudo llaman a esta propiedad “temperatura“, pero los miembros del equipo de Bing dicen que hay más trabajo por hacer con los nuevos estilos conversacionales.

Según un empleado de Microsoft mikhail parakhincambiar de modo en Bing Chat cambia aspectos fundamentales del comportamiento del bot, incluido el cambio entre diferentes modelos de IA que han recibido entrenamiento adicional de las respuestas humanas a su partida. Los diferentes modos también usan diferentes avisos de inicio, lo que significa que Microsoft cambia el aviso de definición de personalidad como se reveló en el ataque de inyección de aviso sobre el que escribimos en febrero.

Si bien Bing Chat todavía está disponible solo para aquellos que se registraron en una lista de espera, Microsoft continúa refinando Bing Chat y otras funciones de búsqueda de Bing con inteligencia artificial mientras se prepara para implementarlo más ampliamente para los usuarios. Microsoft anunció recientemente planes para integrar la tecnología en Windows 11.

“Introvertido. Solucionador de problemas. Aficionado total a la cultura pop. Estudiante independiente. Creador”.